Architektura biznesowa przypomina skomplikowany organizm, w którym przepływ informacji decyduje o przetrwaniu i wzroście. Przez dekady osoby odpowiedzialne za strategię technologiczną w przedsiębiorstwach operowały w ramach paradygmatu, który dziś staje się nie tylko niewydolny, ale wręcz ryzykowny. Tradycyjny podział ról, w którym jedna grupa specjalistów budowała wydajne magistrale przesyłu danych, a druga – często w pewnej izolacji – starała się je zabezpieczyć, odchodzi do lamusa.

Bezpieczeństwo doklejane do gotowych rozwiązań jako ostatni element układanki przestaje spełniać swoją funkcję. Staje się hamulcem, generatorem zbędnych kosztów i, co najgorsze, źródłem fałszywego poczucia kontroli.

Historycznie rzecz biorąc, podstawowym zadaniem dyrektorów ds. informatyki była dbałość o operacyjność i ciągłość procesów. Ochrona aktywów cyfrowych była traktowana jako niezbędny, lecz wtórny dodatek, realizowany często w odpowiedzi na pojawiające się zagrożenia. Dzisiejszy krajobraz regulacyjny, presja ze strony zarządów oraz bezprecedensowa fragmentacja technologiczna wymusiły jednak całkowite odwrócenie tego porządku.

Bezpieczeństwo nie jest już metą, do której się dąży, lecz fundamentem, bez którego nowoczesny biznes nie jest w stanie w ogóle wystartować. Przyjęcie założenia, że ochrona musi być integralną częścią fazy projektowej, to nie tylko wymóg techniczny, ale przede wszystkim dojrzałość biznesowa.

Dyrektorzy IT od lat mierzą się z klasycznym dylematem: jak przyspieszyć cyfrową transformację przy jednoczesnym podnoszeniu poprzeczki bezpieczeństwa, operując w ramach rygorystycznie określonych budżetów. W tradycyjnym ujęciu te dwa cele wydają się wzajemnie wykluczać. Każde dodatkowe zabezpieczenie postrzegane jest jako warstwa zwiększająca opóźnienia, a każda próba przyspieszenia sieci – jako ryzykowne odsłonięcie gardy.

To napięcie jest jednak w dużej mierze iluzją wynikającą z zarządzania dwiema dyscyplinami jako niezależnymi od siebie mechanizmami. Problem nie leży w samej chęci bycia szybkim i bezpiecznym jednocześnie, lecz w architektonicznym rozdrobnieniu, które sprawia, że systemy te zamiast ze sobą współpracować, nieustannie ze sobą rywalizują.

Złożoność stała się cichym wrogiem efektywności. Przez lata przedsiębiorstwa gromadziły punktowe rozwiązania od różnych dostawców, budując ekosystemy składające się z dziesiątek niezależnych konsol, agentów i zestawów reguł. Każdy nowy element tej układanki, choć teoretycznie wzmacniał konkretny wycinek ochrony, w rzeczywistości generował większe tarcie operacyjne.

Powstawały martwe punkty, a zespoły IT traciły czas na ręczną korelację danych z wielu niekompatybilnych źródeł. W takim środowisku zwinność biznesowa staje się pojęciem czysto teoretycznym, ponieważ każda próba zmiany konfiguracji czy wdrożenia nowej usługi wymaga żmudnego uzgadniania sprzecznych ze sobą polityk bezpieczeństwa i sieci.

Rozwiązaniem tego kryzysu jest konwergencja, czyli przyjęcie modelu operacyjnego opartego na zunifikowanych platformach integrujących sieć i bezpieczeństwo w ramach jednego, spójnego źródła danych. Kiedy te dwa światy zaczynają mówić tym samym językiem, konflikt interesów znika. Ochrona przestaje być zewnętrznym filtrem, a staje się natywną funkcją samej infrastruktury.

Pozwala to na uzyskanie bezprecedensowej jasności operacyjnej, nawet w najbardziej rozproszonych środowiskach, od lokalnych centrów danych po publiczne chmury i zdalne punkty dostępowe. Dzięki takiemu podejściu możliwe jest drastyczne skrócenie czasu wykrywania anomalii i powstrzymywania incydentów, zanim zdążą one realnie wpłynąć na wynik finansowy firmy.

Gdy zabezpieczenia są natywnie wbudowane w tkankę sieciową, dochodzi do optymalizacji, której nie sposób osiągnąć metodą nakładania kolejnych warstw. Systemy reagują płynniej, ponieważ eliminowana jest konieczność wielokrotnych inspekcji tych samych pakietów przez odrębne urządzenia. Jednocześnie spójność polityk staje się faktem – te same zasady dostępu i ochrony obowiązują niezależnie od tego, czy pracownik loguje się z głównej siedziby firmy, czy z domowego biura.

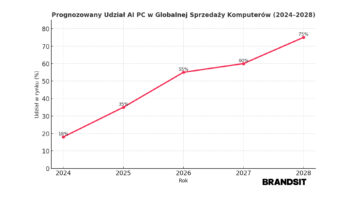

Warto również zauważyć, że żadna, nawet najbardziej zaawansowana platforma, nie zastąpi ludzkiej inteligencji, jednak może ona znacząco zwielokrotnić jej możliwości. Deficyt talentów w obszarze cyberbezpieczeństwa jest wyzwaniem strukturalnym, z którym boryka się niemal każda branża. W tym kontekście sztuczna inteligencja i automatyzacja stają się kluczowymi narzędziami w rękach CIO.

Technologia ta, właściwie zintegrowana z platformą operacyjną, pozwala na błyskawiczną analizę wzorców, podsumowywanie alertów i przejmowanie powtarzalnych, nużących zadań. Dzięki temu wysoko wykwalifikowani specjaliści mogą skupić się na działaniach strategicznych i kreatywnym rozwiązywaniu problemów, zamiast ginąć w gąszczu fałszywych alarmów.

Ewolucja roli dyrektora IT polega dziś na przejściu od zarządzania technologią do budowania odporności biznesowej. Zunifikowane architektury stają się w tym procesie najważniejszym sojusznikiem. Pozwalają one przekształcić wymogi regulacyjne i kwestie zgodności z uciążliwego obowiązku w naturalny, zautomatyzowany proces. Zamiast nieustannego wyścigu z czasem i prób łatania kolejnych luk w zabezpieczeniach, organizacja zyskuje solidny fundament, który wspiera innowacje.

Bezpieczeństwo w takim ujęciu przypomina systemy wspomagania w nowoczesnym samochodzie wyścigowym. Nie są one instalowane po to, aby kierowca jechał wolniej, ale po to, by mógł on z pełnym zaufaniem do maszyny rozwijać maksymalne prędkości, mając pewność, że w sytuacji krytycznej systemy zareagują szybciej i precyzyjniej niż on sam.